Die kürzlich von YouTube vorgestellten neuen Richtlinien für AI-generierte Inhalte stellen eine bedeutende Veränderung im Bereich der Videoerstellung dar. Diese Änderungen, die sich vor allem auf Videos beziehen, in denen AI die Stimmen von Musiker:innen nachahmt, sind für Kreative und professionelle Content-Agenturen von grosser Bedeutung.

YouTubes neue Position zu AI-Inhalten

Die Änderung der YouTube-Richtlinien kommt zu einer Zeit, in der AI-generierte Inhalte, insbesondere Deepfakes, immer ausgefeilter werden. Die Fähigkeit dieser Technologie, die Realität zu imitieren, wirft Fragen zur Authentizität, zu Urheberrechtsverletzungen und zur ethischen Nutzung auf. Für Kreative und Agenturen sind diese Richtlinien nicht einfach nur Regeln, die sie befolgen müssen, sondern ein Rahmen, der ihnen hilft, die Grenzen der kreativen Freiheit und die rechtlichen Beschränkungen im Zeitalter der AI zu verstehen.

Für Inhaltsersteller:innen und Agenturen bedeutet die Anpassung an diese Richtlinien mehr als nur die Vermeidung von Strafen wie die Entfernung von Inhalten oder die Löschung von Inhalten. Es geht darum, Content-Strategien strategisch auf diese neuen Regeln abzustimmen, um ein gutes Standing auf der Plattform zu erhalten und die kreativen Möglichkeiten der KI innerhalb der Grenzen dieser Richtlinien zu nutzen.

Der duale Ansatz von YouTube für AI-generierte Videos

Die Herangehensweise von YouTube an AI-generierte Inhalte schafft eine deutliche Zweiteilung: ein strenges Regelwerk für die Musikindustrie und ein milderes Framework für andere Inhaltsarten. Diese Zweiteilung spiegelt das Bedürfnis von YouTube wider, ein Gleichgewicht zwischen seinen Beziehungen zu verschiedenen Inhaltserstellern und Branchen herzustellen und die einzigartigen Herausforderungen und Auswirkungen von AI-Inhalten in verschiedenen Bereichen zu berücksichtigen.

Dieser doppelte politische Ansatz ergibt sich aus den spezifischen Risiken und Auswirkungen, die AI in verschiedenen Inhaltskategorien hat. AI-generierte Musik, die die Stimme einer Künstler:in imitiert, hat zum Beispiel direkte Auswirkungen auf das Urheberrecht und die Identität der Künstler:in und erfordert daher strengere Richtlinien. Der unterschiedliche Grad an Strenge zwischen den beiden Kategorien schafft jedoch potenzielle Herausforderungen und Unklarheiten, vor allem in Bezug auf die Durchsetzung und Einhaltung.

Für Creators und Agenturen bedeutet dies, sich in einem komplexen Regelwerk zurechtzufinden, das eine sorgfältige Abwägung des Inhaltstyps und seiner möglichen Auswirkungen erfordert. Das Verständnis dieser Unterscheidungen ist entscheidend für die Entwicklung von Inhaltsstrategien, die mit den Richtlinien von YouTube übereinstimmen und die Integrität der Plattform und ihrer Nutzer:innen aufrechterhalten.

Die neue Kennzeichnungspflicht für KI-generierte Inhalte

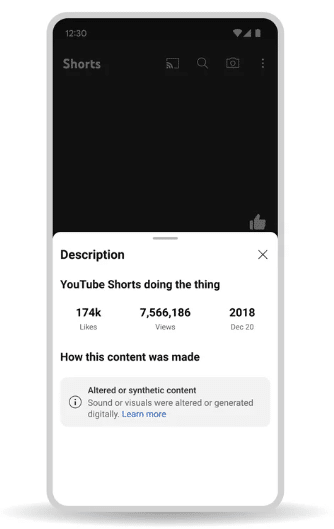

Die YouTube-Richtlinien verlangen nun, dass KI-generierte Inhalte, die «realistisch» sind, gekennzeichnet werden. Dabei wird auch festgelegt, wo und wie diese Kennzeichnungen erscheinen sollen. Das Fehlen einer klaren Definition dessen, was «realistische» Inhalte sind, stellt die Ersteller und Agenturen jedoch vor Herausforderungen bei der Einhaltung der Vorschriften.

Die Unklarheit bei der Definition von «realistischen» KI-Inhalten bedeutet, dass Ersteller:innen und Agenturen vorsichtig und transparent sein müssen. Dazu gehört, dass sie die Kennzeichnungsvorschriften einhalten und sich über die weiteren Auswirkungen von KI-Inhalten auf die Wahrnehmung und das Vertrauen der Zuschauer:innen im Klaren sind.

Die Nichteinhaltung dieser Kennzeichnungsvorschriften kann zu schweren Strafen führen, einschliesslich der Entfernung von Inhalten und der Löschung von Inhalten. Dies unterstreicht, wie wichtig es ist, dass Creators und Agenturen über diese Richtlinien informiert sind und sie einhalten, damit ihre Inhalte auf der Plattform zugänglich und verwertbar bleiben.

Richtlinien zur Entfernung von Inhalten für AI-generierte Videos

Die Richtlinien von YouTube zur Entfernung von Inhalten, insbesondere für Videos, die identifizierbare Personen simulieren, machen die Moderation von Inhalten noch komplexer. Diese Richtlinien berücksichtigen verschiedene Faktoren, z. B. ob es sich bei den Inhalten um Parodien oder Satire handelt und ob die dargestellten Personen öffentliche Persönlichkeiten sind.

Das Verfahren von YouTube zur Bewertung von Anträgen auf Entfernung von Inhalten ist kompliziert und subjektiv. YouTube berücksichtigt verschiedene Faktoren, darunter die Art des Inhalts und den Status der abgebildeten Personen. Dieser subjektive Charakter stellt Creators vor die Herausforderung, vorherzusagen, wie ihre Inhalte beurteilt werden könnten und welche Massnahmen sie als Reaktion auf Löschungsanträge ergreifen müssen. Diese Komplexität erfordert, dass die Creator ein Gleichgewicht zwischen kreativem Ausdruck und der Einhaltung von Gesetzen finden müssen, um sicherzustellen, dass ihre Inhalte nicht versehentlich gegen die Richtlinien von YouTube verstossen.

Urheberrechtsfragen und rechtliche Unklarheiten bewältigen

Die Rechtslage für AI-generierte Inhalte ist voller Unsicherheiten, vor allem, weil es keine speziellen Gesetze gibt, die AI-Depfakes regeln. Die Richtlinien von YouTube könnten in diesem aufstrebenden Bereich einen Präzedenzfall darstellen, aber das Fehlen eines etablierten Rechtsrahmens stellt Creators vor die Herausforderung, sicherzustellen, dass ihre Inhalte innerhalb der rechtlichen Grenzen bleiben.

Neben der Einhaltung von Gesetzen gibt es bei der Erstellung und Verbreitung von AI-Inhalten auch erhebliche ethische Bedenken. Fragen zur Authentizität der Inhalte, zu den Rechten an geistigem Eigentum und zum potenziellen Missbrauch unterstreichen die Notwendigkeit, dass Creator mit AI-Inhalten verantwortungsbewusst und ethisch korrekt umgehen.

Während YouTube seinen Weg bei der Moderation von AI-Inhalten geht, könnten seine Richtlinien einen Einfluss auf breitere rechtliche und ethische Standards in diesem Bereich haben. Für die Creator bedeutet dies, dass sie sich an die aktuellen Richtlinien halten und mit den sich entwickelnden rechtlichen und ethischen Diskussionen über AI-Inhalte Schritt halten müssen.

Besondere Regeln für AI-generierte Musikinhalte

YouTube hat spezielle Regeln für AI-generierte Musikinhalte aufgestellt, die die einzigartige Stimme einer Künstler:in imitieren. Dazu gehören Ausnahmen für Nachrichtenberichterstattung, Analysen oder Kritiken und das Verfahren für Anträge auf Entfernung von Musik. Die Ausnahmen für bestimmte Verwendungszwecke von AI-generierter Musik, wie z. B. für die Nachrichtenberichterstattung oder Kritik, schaffen nur einen sehr engen Raum für kreative Erkundungen innerhalb dieser Richtlinien.

Das Gleichgewicht zwischen Kreativität und Verantwortung in Zukunft

Die YouTube-Strategie für AI-Innovationen betont das Gleichgewicht zwischen Kreativität und Verantwortung. Dazu gehört der Einsatz von AI-Technologie für die Moderation von Inhalten und die wirksame Durchsetzung von Community-Richtlinien, aber auch die Erkenntnis, dass AI das Potenzial hat, neue Formen des Missbrauchs und neue Herausforderungen mit sich zu bringen. Die Bemühungen von YouTube um eine verantwortungsvolle AI-Innovation zielen darauf ab, die Sicherheit der Community und die Einhaltung der Richtlinien zu gewährleisten. Für die Creators bedeutet dies, die Regeln zu befolgen und zu einem sicheren und verantwortungsvollen Online-Umfeld beizutragen.

Die Zukunft der AI-generierten Inhalte auf YouTube birgt ein grosses Potenzial für Innovation und Kreativität. Es bleibt jedoch eine grosse Herausforderung, die Freiheit der Inhalte mit ethischen Erwägungen und der Sicherheit der Gemeinschaft in Einklang zu bringen. Mit dem Voranschreiten der AI-Technologien müssen Kreative den schmalen Grat zwischen der Nutzung dieser Technologien für den kreativen Ausdruck und der Wahrung ethischer Standards und der Sicherheit der Gemeinschaft meistern. Es ist wichtig, über die sich entwickelnden Richtlinien und technologischen Fortschritte informiert zu sein.

Die Entwicklungen bei den KI-generierten Inhalten auf YouTube werden die Zukunft der Inhaltserstellung massgeblich beeinflussen. Für Kreative und Agenturen wird der Schlüssel zum Erfolg in dieser sich entwickelnden Landschaft darin bestehen, sich auf diese Veränderungen einzulassen und gleichzeitig den Fokus auf Verantwortung, Compliance und Innovation zu legen.